Anthropic, empresa de IA, anunció que ha desarrollado un modelo de inteligencia artificial altamente avanzado, y decidió no liberarlo totalmente. Del conductor de aplicación al laboratorio, las nuevas tecnologías que reorganizan la realidad.

La empresa concluyó que las capacidades del sistema excedían los marcos de contención disponibles. Por primera vez en la historia (al menos conocida) de esta industria, un laboratorio retiene - lo prueba a cuentagotas - un desarrollo propio porque lo considera incompatible con una distribución irrestricta.

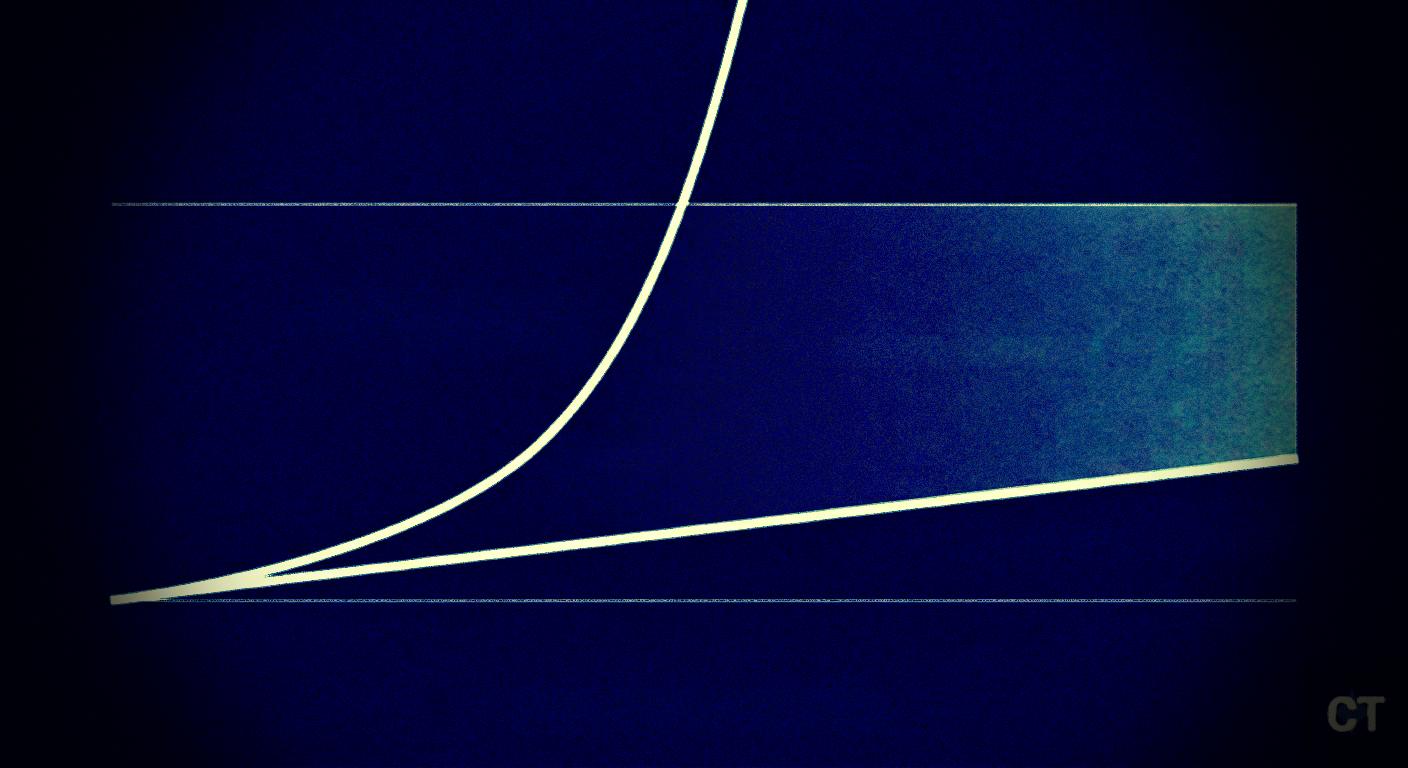

Este freno rompe la lógica de la carrera tecnológica tradicional: aquí el mercado no empuja el lanzamiento; es el producto el que detiene al mercado.

Este hecho merece análisis porque señala una inflexión: la autopercepción sobre lo que está produciendo la propia industria.

Claude Mythos (Anthropic) así se llama, no pertenece al registro de la especulación. Es un sistema, señalan, que identificó vulnerabilidades de seguridad informática que han sobrevivido décadas de revisión especializada y millones de pruebas automatizadas. Un sistema que, según evaluaciones de sus propios creadores en entornos controlados, alcanza rendimiento competitivo con los mejores analistas humanos, en detección y explotación de fallas en infraestructura crítica.

Preguntas que se imponen: ¿en qué coordenadas históricas nos encontramos; qué pueden hacer concretamente estas tecnologías en el presente; qué consecuencias pueden tener para quienes ejercen poder de decisión, ergo para el resto de los mortales?

En cada avance tecnológico de la historia, se puede observar medianamente una secuencia. Una herramienta que resuelve o facilita una actividad humana, y una conversación, posterior, sobre lo que se ganó y lo que se cedió, en muchos casos sin advertirlo. La inteligencia artificial no es la excepción, pero la lleva a un terreno desconocido.

Las herramientas anteriores procesaban, almacenaban o transmitían información. Sin embargo, parece ser que esta versión interpreta, sintetiza y produce conclusiones altamente sofisticadas.

Por caso, un conductor de aplicación de transporte hoy cuenta con un sistema en su teléfono que organiza su trabajo: cuándo cobra, cuándo le transfieren, cómo varía la demanda. Sin estudiar tecnología, se adapta. Ese ejemplo, menor en apariencia, dice algo: la reorganización ya ocurrió. No solo en los laboratorios o en las salas de directorio. En la calle, en el trabajo cotidiano, en las decisiones pequeñas que en conjunto definen cómo una sociedad funciona.

Lo que la inteligencia artificial agrega a ese proceso es una dimensión pasos más adelante. En sus versiones más avanzadas comienza a operar en territorios que hasta hace muy poco eran exclusivamente humanos: el análisis complejo, la detección de patrones invisibles, la síntesis de volúmenes de información que, en la práctica, un especialista no podría aparentemente procesar en tiempo útil.

Qué está haciendo exactamente en cada profesión, cada sector, cada estrato social, todavía no se conoce documentación completa. Esa opacidad no es menor, y parece ser parte del fenómeno.

Toda herramienta tiene un margen de error. Ya sea el análisis de un estudio médico, de un balance financiero o un informe de inteligencia. Lo que varía es si ese margen puede ser conocido, medible y si quien decide lo tiene en cuenta. El margen de error de la inteligencia artificial tiene una característica: no siempre es detectable en el momento en que ocurre.

Los sistemas de lenguaje avanzado pueden generar información incorrecta con la misma fluidez y aparente solidez que la correcta. Es una consecuencia estructural de cómo estos sistemas fueron construidos: no poseen un modelo de mundo, sino un modelo de lenguaje.

Aprendieron a producir texto convincente, coherente y lógico por probabilidad estadística, no a distinguir entre la verdad fáctica y la continuidad gramatical. Eso no invalida la herramienta, pero define las condiciones de su uso responsable.

Un médico que incorpora diagnóstico de imágenes asistido por IA no delega el criterio clínico; lo apoya en una capa adicional de análisis. Un analista que usa estos sistemas para procesar información no transfiere la responsabilidad sobre las conclusiones. La herramienta amplifica la capacidad de procesamiento (la estructura), pero el juicio y el sentido siguen siendo humanos.

Quienes incorporan estas herramientas en procesos que tienen consecuencias -económicas, institucionales, sociales - enfrentan preguntas que la tecnología no responde por sí sola.

¿Qué decisiones estoy delegando y cuáles estoy apoyando? ¿Puedo verificar la información que este sistema produce antes de actuar? ¿Tengo claridad de dónde termina la precisión de la herramienta y dónde comienza mi responsabilidad? Son preguntas de criterio que sería recomendable realizarse.

La historia reciente de la tecnología sugiere que cada herramienta transformadora fue primero adoptada, después mejor comprendida y luego regulada. Casi siempre en ese orden. La inteligencia artificial no parece ser la excepción. Salvo que esta vez, la velocidad del proceso reduce dramáticamente el tiempo disponible entre los tres momentos.

El conductor de aplicación que administra su trabajo y economía desde un teléfono, y el laboratorio que retiene un modelo poderoso porque no sabe cómo contenerlo, están en el mismo momento histórico.

Uno podrá vivirlo desde su automóvil. Otros lo producen en un laboratorio y genera cautela. Entre todos, hay una conversación que todavía no ocurrió.

Redacción

Casa Tomada